2022-03-29 Views439字2 min read繁

神经网络

- 作用:分类,模式识别,连续值预测

- 建立(强行)输入与输出的映射关系,只要是有规律的

- 每一个输入有权重,进行混合(混合时是线性组合),混合达到阈值,可能是个非线性的映射,最后有一个输出

- 激活函数(用来映射)(sigmoid)

- 神经网络层的理解

- 前馈神经网络(无反馈,有向无环图)

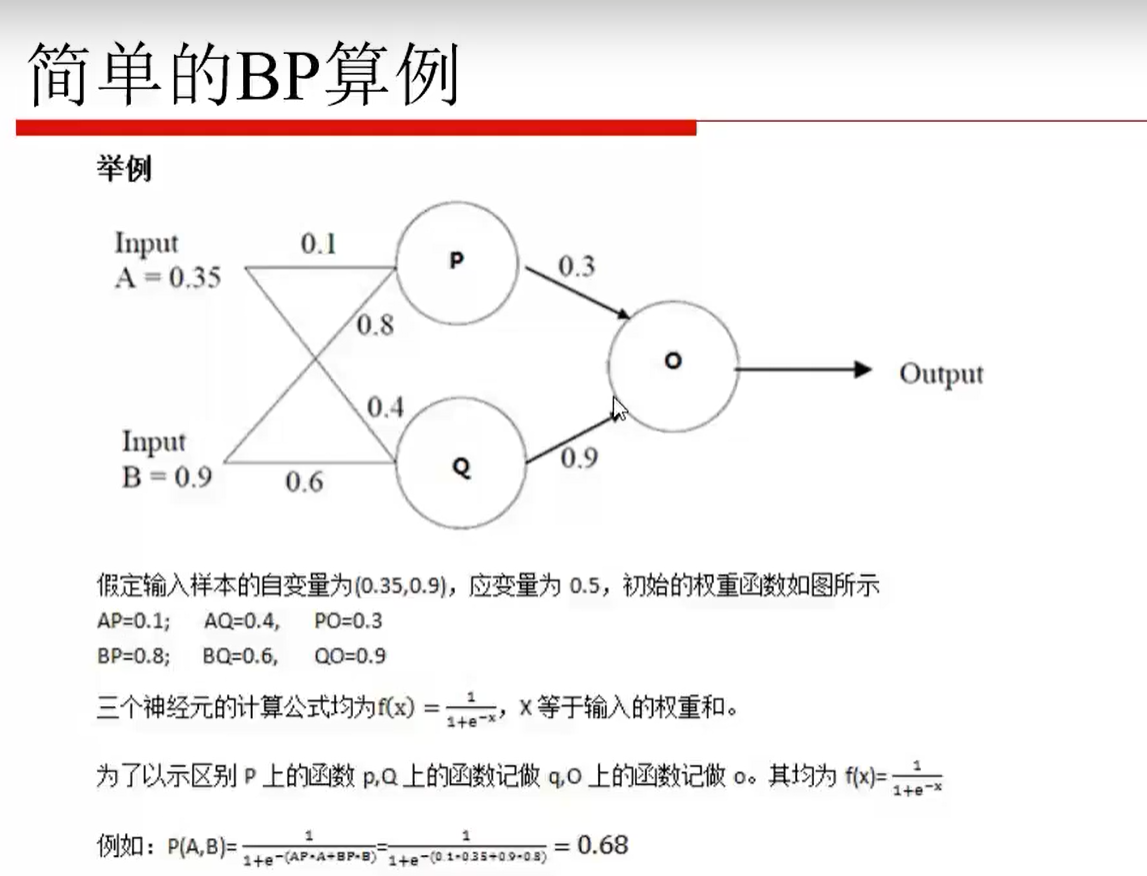

- Delta学习规则(输入输出不变,变的是权重

前馈神经网络

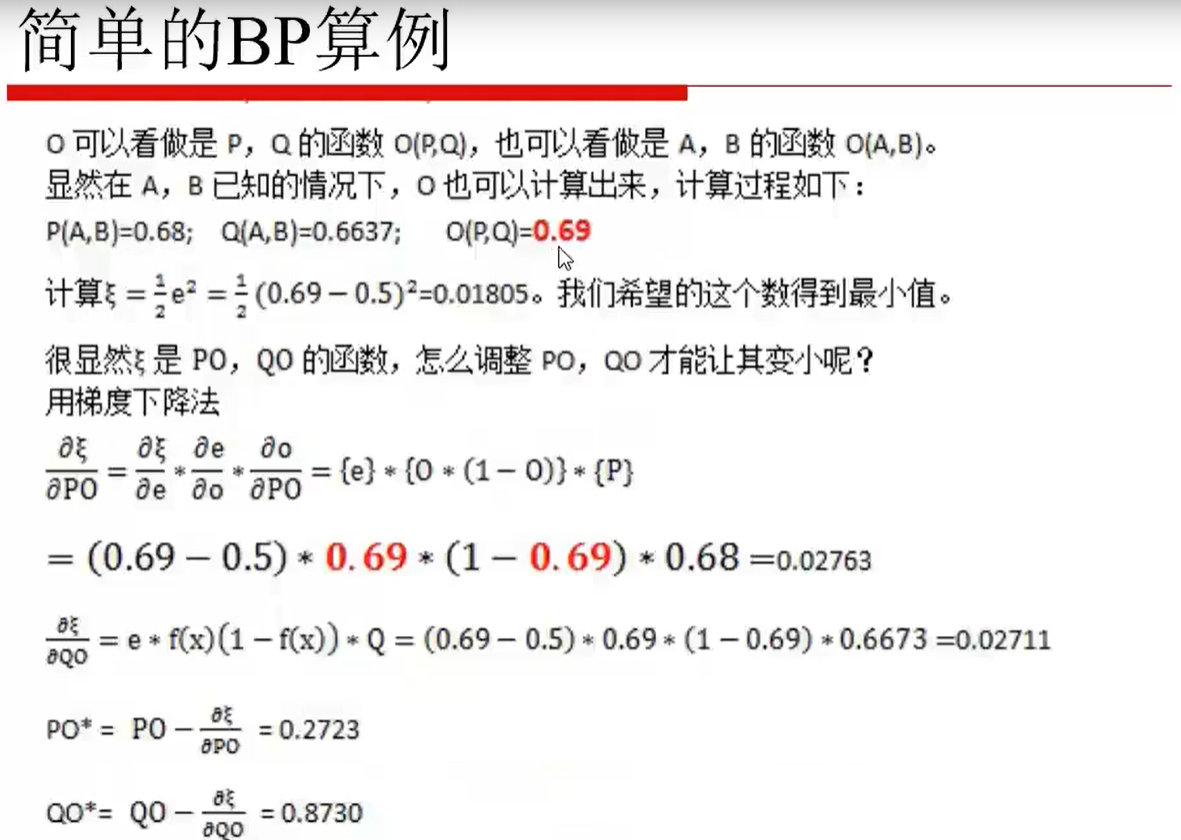

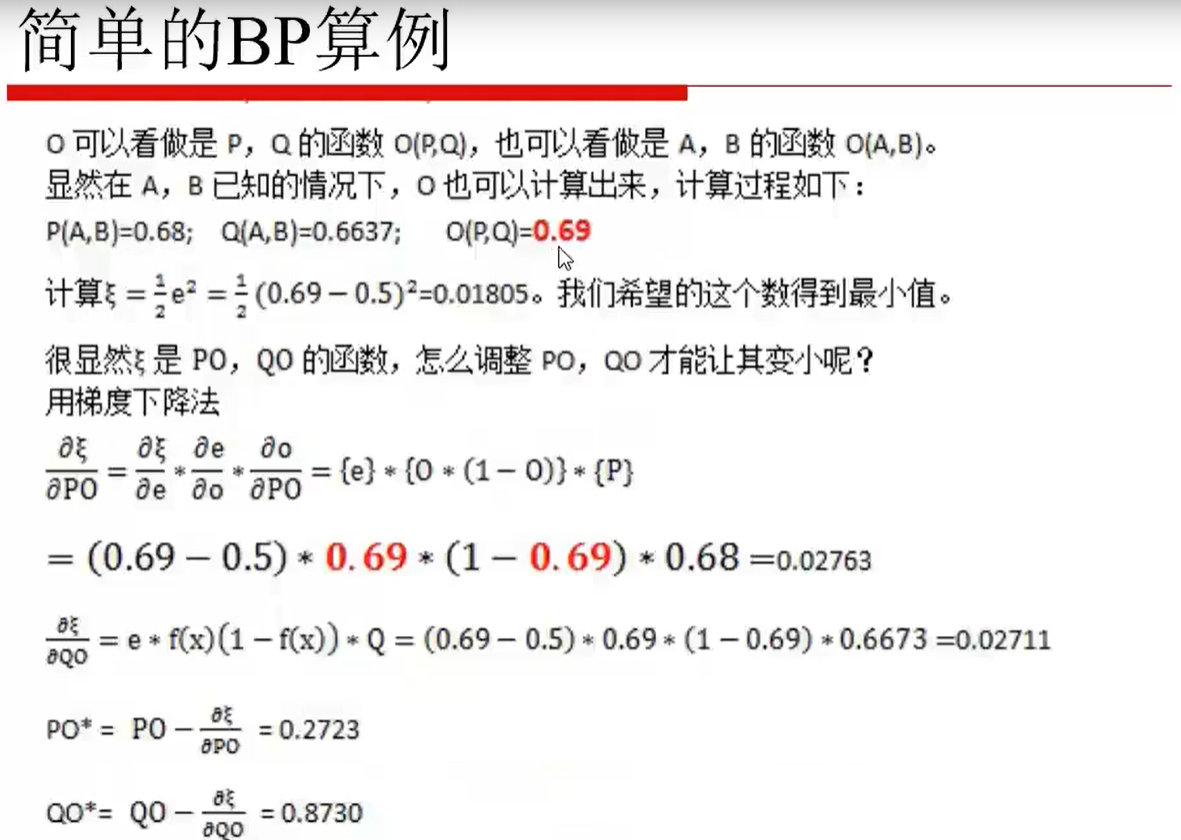

- 目标函数 (各输出误差的平方的累加。目标函数最好为0,目标函数是关于权重的函数)

- 梯度下降

- 是一种迭代过程,梯度相反的方向

- 计算梯度方向,沿梯度方向下降,学习速率,一直迭代直到目标函数不断下降,目标函数处处可导

- w(m+1)=w(m)+Δw(m)=w(m)−η∂w∂J

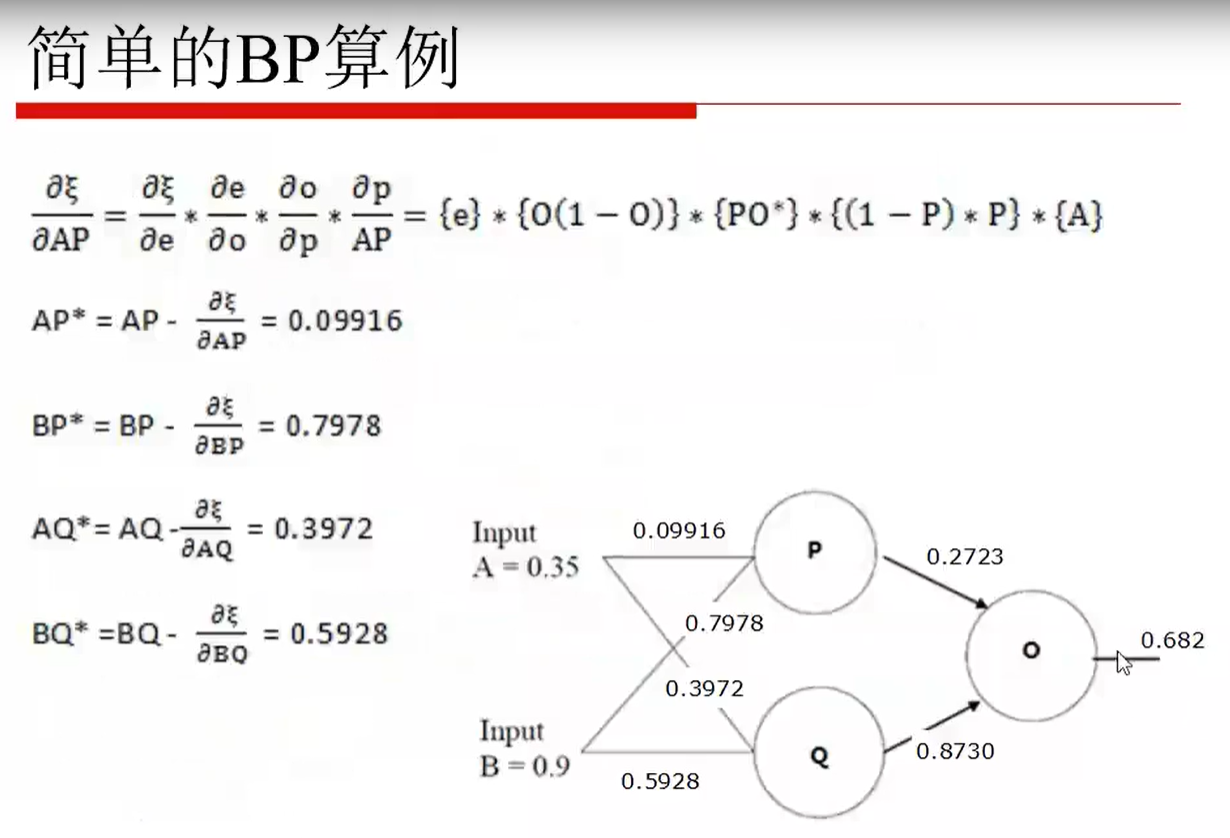

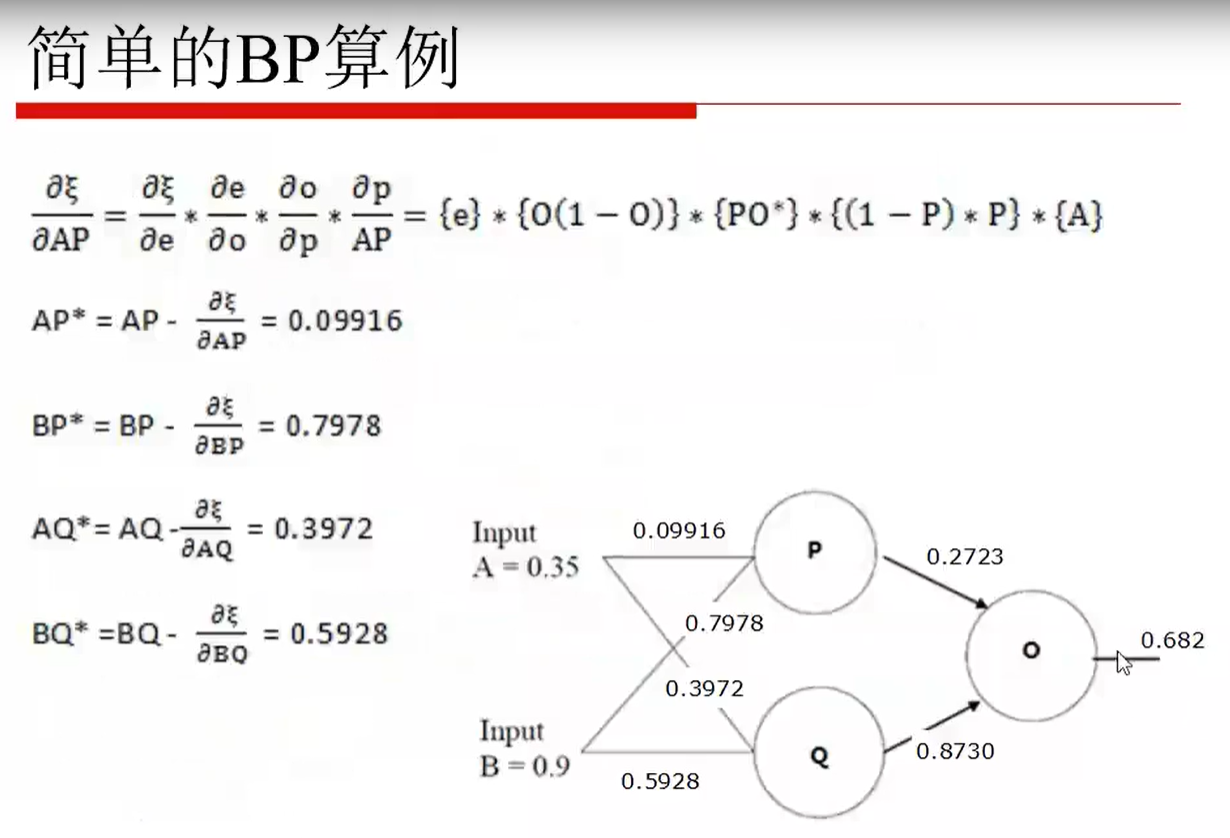

- 误差传播迭代公式

- 输出层

- 隐含层

- 当样本不止一个时,采用批量梯度下降,随机梯度下降

- 深度学习通过算法,来解决机器学习特征提取的不足

- 深度学习

- 一种基于无监督特征学习和特征层次结构的学习模型,其实是对神经网络模型的拓展

-

| 端到端的学习 |

高纬度和大数据 |

| 输入原始数据,输出任何你想要的 |

高纬度的权重参数 |

| 利用算法自动提取的特征进行学习 |

海量的训练数据 |

- https://github.com/hunkim/DeepLearningZeroToAll/

https://blog.csdn.net/u010089444/article/details/76725843

EOF